Cloudflare 史诗级故障完整复盘 2025年11月18日

就在昨天,有 “赛博佛祖” 之称的 Cloudflare 遭遇自 2019 年以来的最严重故障 —— 正常的核心网络流量无法传输,长达六个小时。 ChatGPT…

亚马逊云 AWS 2025年10月20日史诗级故障官方复盘报告

AWS 故障官方复盘报告

今天 AWS 官方发布了 10-20 日美东大故障的事后复盘报告,细节比较丰富,算是少有的第一手资料。所以老冯把它翻译成了中文,并附上…

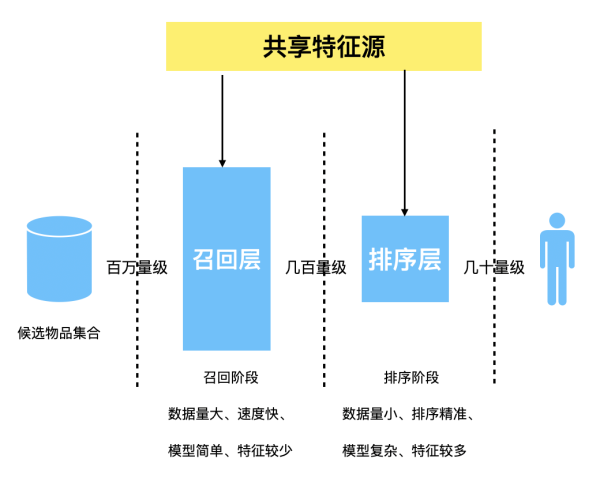

推荐系统召回策略之多路召回与Embedding召回

多路召回与Embedding召回

图1. 推荐系统整体架构 —

推荐系统学习笔记系列链接:

推荐系统学习笔记——特征工程

推荐系统学习笔记召回策略之基于内…

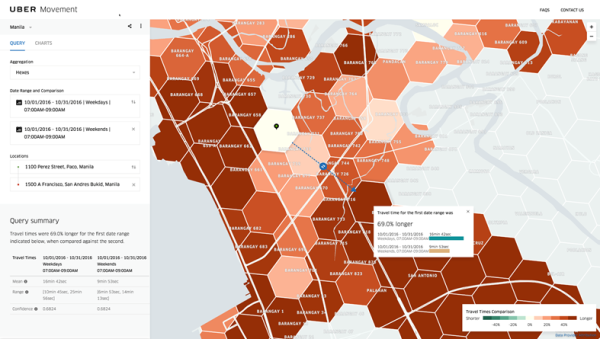

空间索引之Uber H3 – 标点符

网格系统(Grid System)对于分析海量空间数据集,将地球空间划分为可识别的网格单元(cell)至关重要。H3是由Uber开源的一个六边形分层索引网格系统…

漫画 Transform: 手把手用数学公式推导

我学习的时候总有个执念:这个背后的底层原理是什么?

这个执念经常会让我在理解新的知识的时候,造成很大的障碍。如果我不能理解它的底层原理,我就很难去理解在它基础上…

神经网络算法 – 一文搞懂Transformer

(slot:series,id=transformer)

本文将从Transformer的本质、Transformer的原理、Transformer架构改…

神经网络算法 – 一文搞懂 Transformer(总体架构 & 三种注意力层)

(slot:series,id=transformer)

本文将从Transformer的本质、Transformer的原理、Transformer的…

神经网络算法 – 一文搞懂Embedding(嵌入)

(slot:series,id=transformer)

本文将从Embedding的本质、Embedding的原理、Embedding的应用三个方面,带…

Transformer动画讲解 – 注意力机制

(slot:series,id=transformer)

Transformer注意力机制

从端到端的角度来看,数据在Transformer中的流转可以概括…

神经网络算法 – 一文搞懂Attention(注意力)机制

(slot:series,id=transformer)

本文将从Attention的本质、Attention的原理、Attention的应用三个方面,带…

Transformer动画讲解 – Cross Attention

(slot:series,id=transformer)

Cross Attention

编码器-解码器注意力:在“编码器-解码器注意力”层中,查询来自…

Transformer动画讲解 – 单头注意力和多头注意力

(slot:series,id=transformer)

单头注意力和多头注意力

Transformer的起源:Google Brain 翻译团队通过论…

神经网络算法 – 一文搞懂Self-Attention和Multi-Head Attention

(slot:series,id=transformer)

随着Transformer模型的迅速普及,Self-Attention(自注意力机制)和Mult…

Transformer动画讲解 – 注意力计算Q、K、V

(slot:series,id=transformer)

注意力计算Q、K、V

Transformer的起源:Google Brain 翻译团队通过论文…

Transformer动画讲解 – 数据处理的四个阶段

(slot:series,id=transformer)

Transformer数据处理的四个阶段

Transformer模型是一种基于自注意力机制的神…

Transformer动画讲解 – Softmax函数

(slot:series,id=transformer)

Transformer的Softmax函数

Transformer的Softmax函数:用于将原始…

Transformer动画讲解 – 多层感知机制

(slot:series,id=transformer)

Transformer多层感知机

从端到端的角度来看,数据在Transformer中的流转可以…

神经网络算法 – 一文搞懂FFNN(前馈神经网络)

(slot:series,id=transformer)

本文将从FFNN的本质、FFNN的原理、FFNN的应用三个方面,带您一文搞懂 Feed-forw…